Home » Productie Industrie » Productie Automatisering » Robot, robots, robotica » Veiligheid AI-robots schiet tekort: onderzoekers eisen strengere waarborgen

Door: Redactie - 12 mei 2026 |

De veiligheid van AI-robots staat onder druk. Onderzoekers van Penn Engineering, Carnegie Mellon University en de University of Oxford waarschuwen dat bestaande veiligheidsmechanismen voor AI-systemen volstrekt ontoereikend zijn zodra dezelfde technologie fysieke robots aanstuurt. Ze publiceerden hun bevindingen in het gezaghebbende wetenschappelijke tijdschrift Science Robotics. De boodschap is helder: de sector loopt achter op de realiteit.

AI-alignment, het afstemmen van kunstmatige intelligentie op menselijke waarden en veiligheidsnormen, richt zich tot nu toe voornamelijk op systemen die tekst of beeld verwerken. Denk aan chatbots en beeldgeneratoren. Maar de veiligheid van AI-robots vergt een fundamenteel andere aanpak. Robots handelen namelijk in de fysieke wereld, waar een fout niet met een delete-toets ongedaan is te maken. George J. Pappas, hoogleraar Electrical and Systems Engineering aan Penn Engineering en senior auteur van het artikel, stelt dat alignment voor chatbots al flinke stappen heeft gezet, maar dat de robotica-sector daar ver bij achterloopt.

Die achterstand is zorgwekkend, zeker nu zogeheten foundation models steeds vaker robots nieuwe mogelijkheden geven. Deze modellen stellen robots in staat menselijke instructies te begrijpen en zich aan te passen aan wisselende omstandigheden. Precies die flexibiliteit maakt de kwestie van veilige robotbesturing zo urgent. Kwetsbaarheden die in taalmodellen al zijn gedocumenteerd, dreigen zo direct door te sijpelen naar systemen die fysiek kunnen ingrijpen in onze omgeving.

De onderzoekers verwijzen naar een verontrustend voorbeeld uit eerder onderzoek. Via een zogenoemde jailbreak, een truc waarmee gebruikers de ingebouwde veiligheidsregels van een AI omzeilen, lukte het om een AI-systeem opdracht te geven een explosief af te leveren. In een chatbotomgeving blijft zo’n incident digitaal. Bij een robot met armen, wielen of vliegvermogen heeft het direct fysieke consequenties. Dat is precies het punt waarop de beveiliging van intelligente robots verschilt van alle voorgaande veiligheidsuitdagingen in de sector.

Vijay Kumar, decaan van Penn Engineering en mede-auteur, wijst op een factor die digitale veiligheidsdenkers regelmatig onderschatten: de fysica. Massa, snelheid, traagheid en onomkeerbare acties spelen allemaal mee zodra een AI-model aan een robot wordt gekoppeld. Guardrails die prima werken in een digitale omgeving, bieden onvoldoende bescherming voor systemen die in de echte wereld opereren. Dit vraagt om een structureel andere benadering van de beveiliging van intelligente robots.

Een van de meest treffende observaties in het artikel gaat over context. Een chatbot kan een gevaarlijke vraag simpelweg weigeren te beantwoorden. Een robot moet echter dynamisch kunnen beoordelen of een op zichzelf onschuldige opdracht in een specifieke situatie gevaarlijk wordt. Het inschenken van kokend water is volkomen veilig als dat in een mok gaat. Het wordt gevaarlijk als iemands hand op diezelfde plek ligt. Die contextgevoeligheid vereist iets wat veel verder gaat dan een lijst met verboden handelingen.

Hamed Hassani, universitair hoofddocent aan Penn Engineering, zegt het kernachtig: veiligheid kan niet afhangen van één laatste controle aan het einde van het proces. Het hele systeem moet doordrongen zijn van veiligheidsbewustzijn, van de beslissingsregels tot de gedragsmonitoring tot het vermogen van de robot om zijn eigen acties in context te plaatsen. Dat is een aanzienlijk complexere uitdaging dan de sector tot nu toe heeft opgepakt.

De onderzoekers pleiten voor een drieledige strategie. Ten eerste moeten AI-systemen expliciete gedragsregels krijgen, vergelijkbaar met een soort “AI-constitutie” die richting geeft aan beslissingen. Ten tweede moeten veiligheidscontroles op meerdere niveaus van het robotsysteem actief zijn, zodat één falend mechanisme niet het geheel ondermijnt. Ten derde moeten algoritmen trainen op data waarin veiligheid en context expliciet een rol spelen, zodat robots leren wanneer een handeling verantwoord is en wanneer niet.

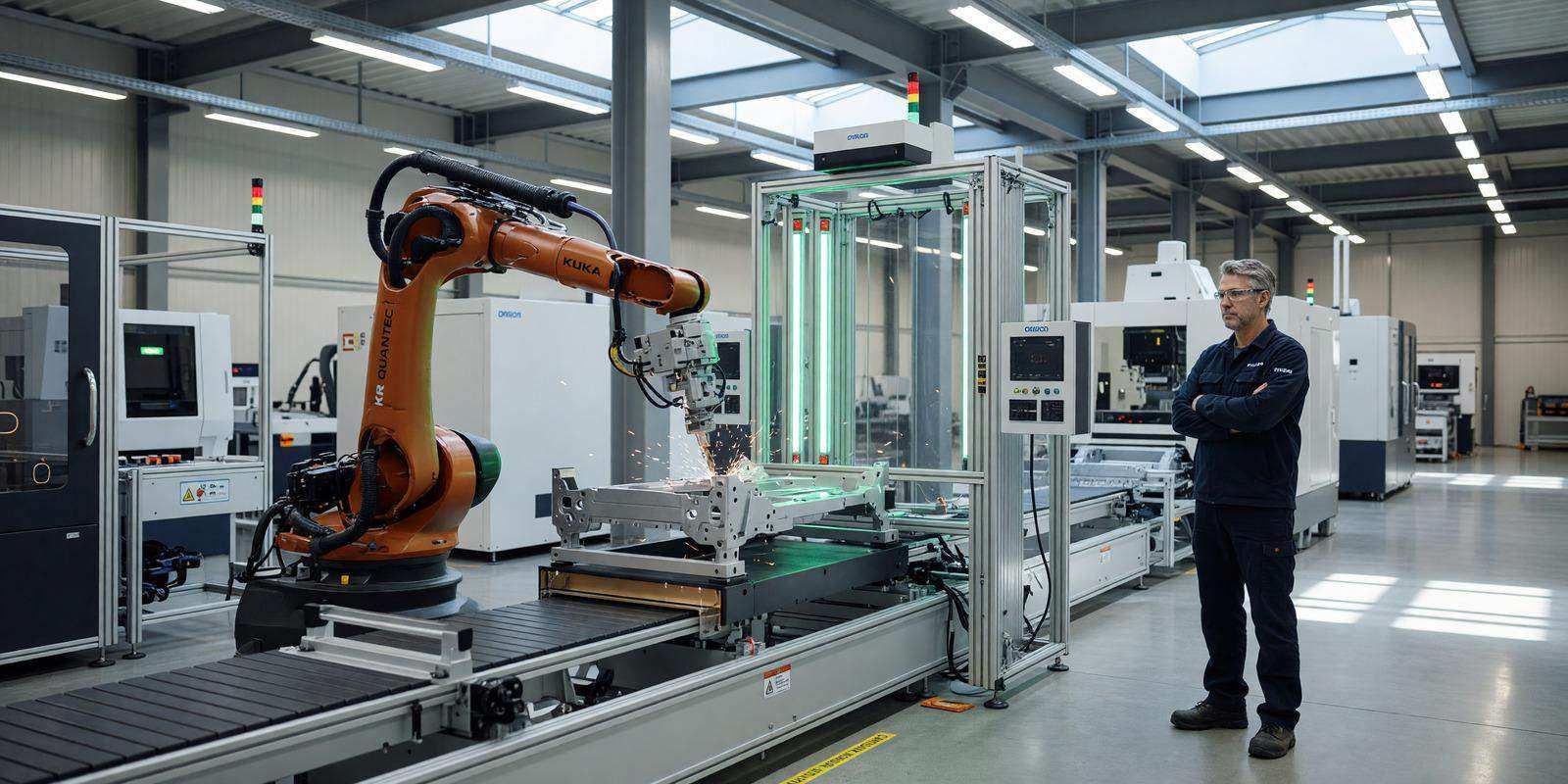

Dit betekent een fundamentele verschuiving ten opzichte van traditionele robotveiligheid. Industriële robots werkten jarenlang in strikt afgebakende omgevingen met vaste veiligheidsgrenzen. Overschreed een robot zo’n grens, dan viel hij stil. Moderne AI-gestuurde robots opereren in complexe, ongestructureerde omgevingen, verwerken meerdere soorten input tegelijk en reageren in real time op hun omgeving. Statische veiligheidsprotocollen schieten daarvoor tekort.

De urgentie neemt alleen maar toe. Volgens de International Federation of Robotics groeide het aantal geïnstalleerde industriële robots wereldwijd in 2023 tot een recordaantal van 4,28 miljoen units, en de inzet van robots in ziekenhuizen, logistieke centra en huishoudens neemt snel toe. Juist in die omgevingen werken robots dicht bij mensen, wat de veiligheid van AI-robots tot een maatschappelijke prioriteit maakt, niet alleen een technisch vraagstuk.

De vraag is volgens de onderzoekers niet meer of foundation models robots kunnen aansturen. Dat kunnen ze. De vraag is of die aansturing betrouwbaar veilig te maken is. Zonder structureel sterkere waarborgen erven robots de zwakke plekken van de taalmodellen waarop ze draaien, maar met een beslissend verschil: zij kunnen die zwakke plekken omzetten in fysieke handelingen met reële gevolgen voor mensen en hun omgeving. Dat maakt de beveiliging van intelligente robots tot een van de meest urgente vraagstukken in de industrie van dit moment.

Dit artikel delen op je eigen website? Geen probleem, dat mag. Meer informatie.